Tento článok poskytuje podrobného sprievodcu o používaní tokenizérov v Hugging Face Transformers.

Čo je tokenizér?

Tokenizer je dôležitým konceptom NLP a jeho hlavným cieľom je preložiť nespracovaný text na čísla. Na tento účel existujú rôzne techniky a metodológie. Je však potrebné poznamenať, že každá technika slúži na konkrétny účel.

Ako používať tokenizéry v Hugging Face Transformers?

Ako používať tokenizéry v Hugging Face Transformers?

Knižnica tokenizer musí byť najprv nainštalovaná pred jej použitím a importovaním funkcií z nej. Potom trénujte model pomocou funkcie AutoTokenizer a potom poskytnite vstup na vykonanie tokenizácie.

Hugging Face predstavuje tri hlavné kategórie tokenizácie, ktoré sú uvedené nižšie:

- Tokenizér založený na slove

- Tokenizer založený na postavách

- Tokenizér založený na podslovách

Tu je podrobný návod na používanie tokenizérov v Transformers:

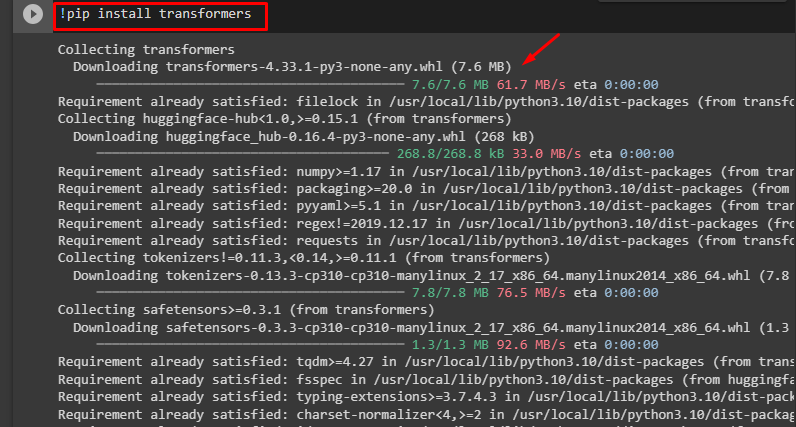

Krok 1: Nainštalujte transformátory

Ak chcete nainštalovať transformátory, použite príkaz pip v nasledujúcom príkaze:

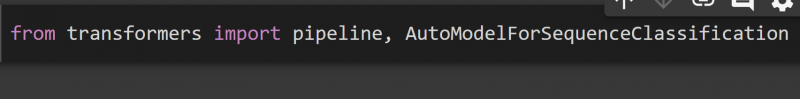

Krok 2: Import tried

Z transformátorov, dovoz potrubia , a AutoModelForSequenceClassification knižnica na vykonanie klasifikácie:

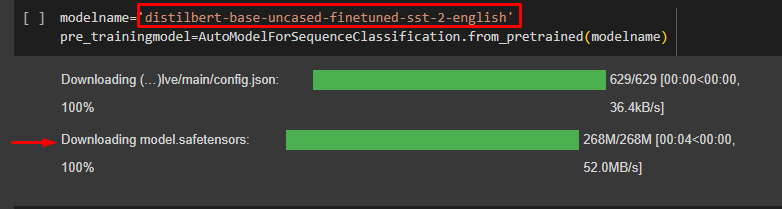

Krok 3: Importujte model

' AutoModelForSequenceClassification ” je metóda, ktorá patrí do Auto-Class pre tokenizáciu. The from_pretrained() metóda sa používa na vrátenie správnej triedy modelu na základe typu modelu.

Tu sme uviedli názov modelu v „ meno modela ” premenná:

meno modela = 'distilbert-base-uncased-finetuned-sst-2-english'pred_tréningový model =AutoModelForSequenceClassification.from_pretrained ( meno modela )

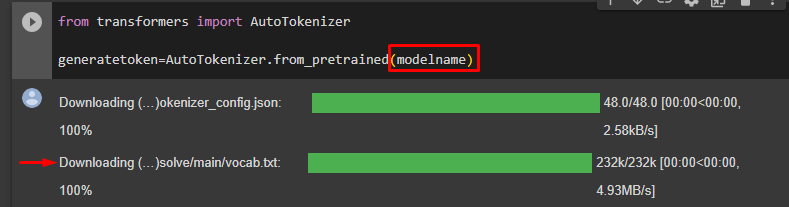

Krok 4: Importujte AutoTokenizer

Zadajte nasledujúci príkaz na generovanie tokenov odovzdaním „ meno modela “ ako argument:

vygenerovaný token =AutoTokenizer.from_pretrained ( meno modela )

Krok 5: Vygenerujte token

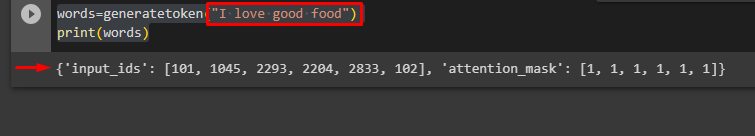

Teraz vygenerujeme tokeny na vete “Milujem dobré jedlo” pomocou „ vygenerovaný token ” premenná:

vytlačiť ( slová )

Výstup je daný nasledovne:

Kód k vyššie uvedenému Google Co je uvedené tu.

Záver

Ak chcete použiť tokenizéry v Hugging Face, nainštalujte knižnicu pomocou príkazu pip, natrénujte model pomocou funkcie AutoTokenizer a potom poskytnite vstup na vykonanie tokenizácie. Pomocou tokenizácie priraďte váhu slovám, na základe ktorých sú zoradené, aby sa zachoval význam vety. Toto skóre tiež určuje ich hodnotu pre analýzu. Tento článok je podrobným sprievodcom, ako používať tokenizéry v Hugging Face Transformers.